По меркам мира технологий эпоха «умных» голосовых ассистентов началась очень давно — Apple представили свою Siri еще в 2011 году, продемонстрировав, что компьютером можно не просто управлять голосом, но и делать это максимально естественным образом. Идея управления техникой при помощи речевых команд была настолько красива и футуристична, что вопросы безопасности принципиально новой технологии взаимодействия остались в стороне от общего внимания. Спустя восемь лет эксперты по кибербезопасности и правительства стран всерьёз озаботились вопросом конфиденциальности личных данных, которыми оперируют голосовые ассистенты явно и тайно. Как оказалось, в «умных» устройствах предостаточно неожиданных уязвимостей, а способов превентивной защиты практически не существует.

Рынок «умных» ассистентов

За Apple подтянулся Google, интегрировав своего Assistant во все Android-смартфоны начиная c 2016 года. Сегодня число телефонов с Google Assistant перевалило за 1 миллиард, количество проданных iPhone с Siri тоже подобралось к этой отметке.

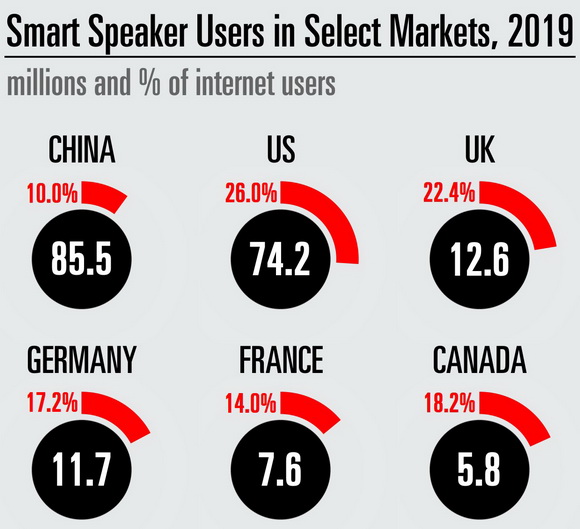

Рынок смарт-спикеров в некоторых странах: указано число проданных устройств и процентная доля от общего числа интернет-пользователей. Источник: eMarketer, 2018

Более перспективной областью интеграции голосовых ассистентов являются домашние «умные» колонки, выполняющие функцию «хаба» для «умного» дома. Их рынок пока мал и молод (ещё моложе, чем технология), но возможности таких хабов даже более впечатляющие, чем у смартфонов. Вместе с тем, их защищённость от взлома и несанкционированного доступа, мягко говоря, очень слаба.

Количество активных «умных» колонок в мире в этом году превысило 200 миллионов штук, большая часть из которых приходится на Китай и США.

Несанкционированные команды

На стадии разработки «умных» ассистентов создатели оперируют традиционными инструментами безопасности — токены, шифрование, туннелирование, сертификаты. Но неожиданные бреши в приватности обнаруживают уже сами пользователи или их дети.

Каждый рассказ о проблемах с «умными» колонками принято начинать с описания случая, произошедшего в США в 2017 году: пока родителей не было дома, шестилетняя девочка заказала через колонку Amazon Echo дорогой кукольный домик и печенье. Возможность быстрых покупок голосом является гордостью Amazon — это помогает упростить процесс шопинга до произнесения команды «Алекса, закажи мой любимый стиральный порошок». К сожалению, Alexa подчинится команде любого человека, в том числе и ребенка.

Курьёзный случай дошел до СМИ. Во время обсуждения по телевидению ведущий шоу, восхищаясь находчивостью девочки, повторил обращение ребёнка к «умной» колонке — в этот момент тысячи Amazon Echo в США одномоментно отреагировали на реплику из телевизора. К счастью для телезрителей, для списания денег необходимо было подтвердить заказ ещё одной репликой, но проблема несанкционированного голосового доступа к «умному» ассистенту стала очевидной для всех.

Кстати, эту уязвимость эксплуатировал Burger King в своей видеорекламе, в которой официант обращался к Google Assistant с просьбой рассказать о бургере — после возмущения владельцев колонок Google Home сеть фастфуда прекратила демонстрацию ролика.

Затем специалисты по безопасности обнаружили, что голосовые ассистенты слышат команды, «зашифрованные» шумом — достаточно наложить голосовую команду на другие звуки особым образом, так что она не будет слышна человеку, но останется различимой для «умного» ассистента. Дело в том, что множество одновременных звуков человек воспринимает как неразличимую какофонию, но для компьютера они остаются раздельными понятными аудиодорожками. Таким образом команды можно скрывать в музыке или просматриваемых видеороликах — пользователь «умной» колонки даже не поймёт, почему его устройство внезапно совершило покупку или выполнило другое действие.

С тех пор Amazon Alexa научилась распознавать голоса — к каждому аккаунту Amazon можно «привязать» голос владельца.

Сейчас эксперты предлагают защитить выполнение команд голосовым паролем — кодовым словом, известным только владельцу. Вероятность, что кодовое слово не станет известно другим членам семьи и детям, крайне мала. Единственным надёжным способом предотвращения несанкционированных покупок через голосового ассистента является отключение этой функции.

Официальная «утечка» аудиозаписей

Даже если вы не представляете интерес для спецслужб, это не значит, что вас не прослушивают: в 2019 году сразу три технологических гиганта влипли в неприятную историю с передачей сторонним компаниям голосовых записей, полученных через «умных» ассистентов Amazon Alexa, Google Assistant и Apple Siri.

Совершенствование распознавания человеческой речи происходит не только в центрах разработки — ни одна лаборатория и группа испытуемых не сможет дать такого разнообразия произношений, акцентов и тональностей, какую можно собрать у миллионов пользователей «умных» колонок. Именно с этой целью Google, Amazon и Apple сохраняли часть аудиозаписей, полученных через голосовых ассистентов, и отправляли их на расшифровку сторонним организациям. Проще говоря, на сторону утекали не просто обезличенные команды, преобразованные в текст, — посторонние люди слушали всё содержимое аудиозаписей, включая фоновые звуки. Притом фоновыми звуками могли быть как моменты чьей-то сугубо личной жизни, так и разговоры чрезвычайно конфиденциального характера.

После разгоревшегося скандала Google, Apple и Amazon поспешили прекратить сбор аудиозаписей от «умных» ассистентов и уверили, что аудиодескрипции подвергалось только около 0,2% от всех зарегистрированных команд. Покупателям от этого факта легче не стало. У Google и Amazon также появились специальные страницы, на которых можно просмотреть свою историю обращений и удалить её. История обращений ведётся с момента покупки устройства и хранится на серверах до тех пор, пока пользователь сам её не удалит.

Практика расшифровки аудиозаписей не прекратилась, прекратился лишь их тайный сбор. Теперь пользователи «умных» ассистентов должны сами согласиться с отправкой своих команд третьим лицам для помощи в улучшении системы распознавания голоса.

Удалённое прослушивание с микрофона

Стоит сказать и о самой жуткой страшилке покупателей «умных» колонок — может ли хакер удалённо получить доступ к микрофону колонки, чтобы слышать всё, что происходит в доме? Может, причём относительно честным образом.

«Умные» колонки Amazon и Google работают с подключаемыми сторонними программируемыми наборами команд, представляющими собой микроприложения с голосовым управлением. Эти микроприложения загружаются из онлайн-магазинов, модерация в которых, как оказалось, не отличается требовательностью к безопасности.

Специалисты Security Research Labs написали и отправили на модерацию восемь фейковых развлекательных микроприложений для «умных» колонок, которые должны были тайно оставлять микрофон колонки включённым и отправлять на сторонние серверы записанные разговоры. К удивлению экспертов компании, все восемь программ успешно прошли проверку и заняли свои места в магазинах Google и Amazon.

Одно из таких приложений маскировалось под астрологический ресурс. После произнесения гороскопа для названного знака приложение включало микрофон в колонках Google и Amazon, переводило услышанную речь в текст и передавало его на сервер Security Research Labs. По сути эксперты по безопасности показали, что злоумышленники могут получить доступ к аудиозаписям с колонок, злоупотребляя официальным магазином приложений. Единственная сложность этого метода заключалась в необходимости распространения такого «троянского приложения» — сам по себе он не может инсталлироваться на «умной» колонке, пользователь должен сам найти и установить его.

После публикации сообщения Google и Amazon убрали опасные приложения из своих магазинов и пообещали усилить контроль за всеми сторонними программными инструментами. Но не стоит надеяться исключительно на модераторов, в любом случае нужно придерживаться правил цифровой гигиены: устанавливать только давно известные приложения с большим числом позитивных отзывов.

Взлом «умной» колонки

По состоянию на 2019 год не подтверждено ни одного случая настоящего удалённого взлома «умных» ассистентов и смарт-колонок. Это не отменяет того, что злоумышленники действительно получали доступ к чужим колонкам, чаще всего гаджетам Nest.

В США некто подключился к хабу «умного» дома, установил опасно высокую температуру на термостате обогрева и заодно пообщался через динамик IP-камеры Nest с ребёнком в доме. Отец семейства был напуган, но эксперты считают, что речь шла не о целенаправленном взломе устройства, а лишь о входе с помощью скомпрометированного пароля — очень часто пользователи защищают свои гаджеты либо слишком простым паролем, либо тем же, что используют где-то в интернете. При выключенной двухфакторной аутентификации и пароле в духе «qwerty123» даже самое защищённое устройство раскроет свои секреты перед любым злоумышленником.

Универсальная защита

Если вас по-настоящему беспокоит ваша приватность, просто временно воздержитесь от использования «умных» колонок и смарт-ассистентов в принципе. Каждый год обнаруживаются всё новые и новые бреши в безопасности, и неизвестно, сколько из них ещё открыты. Какого-то универсального решения по защите своего «умного» ассистента пока не существует, есть лишь разрозненный комплекс мер по повышению уровня безопасности.

Принудительное отключение микрофона на смарт-колонке нажатием кнопки, во-первых, не является доказанной защитой от потенциального прослушивания, а во-вторых, девальвирует саму идею всегда готового к командам «умного» ассистента.

Если разработчики голосовых ассистентов ещё могут поручиться, что сторонние сервисы и хакеры не получат доступа к вашим личным данным, то едва ли кто-то сможет гарантировать непредоставление такого доступа государственным органам безопасности. Конечно, в СМИ пока не описаны случаи прослушивания смарт-колонок предполагаемых преступников, но ведь информация о подобных вещах обычно публичной и не становится.

Автор статьи: региональный менеджер Trend Micro в Украине, Молдове и Беларуси.