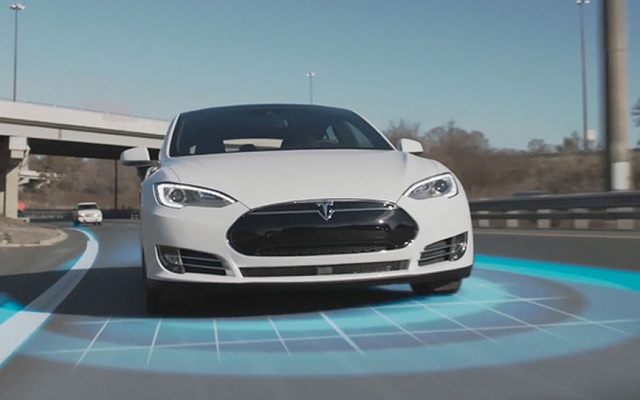

Исследователи выявили, что если показать на рекламном щите, подключенном к интернету, несколько кадров знака Стоп в течение 3-4 десятых секунды, то это может повлиять на поведение автопилота Tesla и привести к непрогнозированной остановке машины.

Проблемы безопасности автоматизированных систем помощи водителю обычно связаны с тем, что машина не может увидеть и правильно идентифицировать некоторые объекты. Например, в 2016 году автопилот Tesla «перепутал» белый фургон автопоезда с ярким небом, что привело к смерти водителя. Однако на этот раз группа исследователей сфокусировалась не на том, что автономные системы вождения не способны увидеть, а наоборот на том, что они «видят», а водитель-человек не способен заметить, включая «фантомные» объекты и знаки, которых на самом деле нет. Все это порождает хаос на дороге.

Исследователи из израильского университета Ben Gurion University в Негеве в течение последних двух лет экспериментировали с этими «фантомными» изображениями, чтобы обмануть полуавтономные системы вождения. Ранее они выявили, что если транслировать на долю секунды световые проекции дорожных знаков или пешеходов на дорогах, то это позволяет успешно обмануть систему помощи водителю Tesla и заставить машину автоматически остановиться без предупреждения. В ходе нового исследования они выявили, что могут выполнить тот же трюк, если вставить в видеоролик на рекламном щите всего несколько кадров с изображением дорожного знака на. Ученые предупреждают, что если хакеры взломают подключенный к интернету рекламный щит, то смогут обмануть системы автоматического вождения для создания масштабных заторов на дорогах или даже дорожно-транспортных происшествий. При этом они не оставят на месте преступления никаких следов и доказательств.

«Злоумышленник просто покажет изображение какого-либо объекта на дороге или вставит несколько кадров в цифровой билборд, и машина затормозит или может даже свернет в сторону. И в этом заключается наибольшая опасность, – комментирует Израиль Мирски (Yisroel Mirsky), исследователь из Ben Gurion University и Georgia Tech. – Водитель даже ничего не заметит. То есть, чья-то машина просто отреагирует на фантомную угрозу, но другие водители даже не поймут, в чем проблема».

В первом раунде исследования, опубликованном ранее в этом году, команда проецировала изображения человеческих фигур на дорогу, а также дорожные знаки на деревья и другие поверхности. Они обнаружили, что ночью, когда проекции были видны особенно хорошо, они могли обмануть систему HW2.5 Autopilot на Tesla Model X – это самая новейшая версия, доступная на момент исследования. Кроме того, им удалось перехитрить и устройство Mobileye 630, интеллектуальную систему предотвращения столкновений автомобилей, показав на долю секунды проекцию «призрачного пешехода». Кроме того, исследователи заставили Mobileye сообщить водителю об ограничении скорости, которого не было, посредством проецируемого дорожного знака.

В последней серии экспериментов исследователи вставили кадры с изображением знака Стоп в видео на цифровых рекламных щитах, моделируя ситуацию, когда хакеры взломали придорожный рекламный щит, чтобы изменить его видео. Они также сделали апгрейд до последней версии Autopilot Tesla, известной как HW3, показав, что могут снова обмануть Tesla или же заставить систему Mobileye генерировать водителю ошибочные предупреждения с помощью всего лишь нескольких кадров измененного видео.

Исследователи выяснили, что изображение, появляющееся в течение всего 0,42 секунды, гарантировано обманывает автопилот Tesla, в то время как изображение, появляющееся всего на одну восьмую секунды, вводит в заблуждение устройство Mobileye. Они также экспериментировали с наличием пятен в видеокадре, которые привлекали бы наименьшее внимание человеческого глаза. Притом они зашли так далеко, что разработали собственный алгоритм для определения ключевых блоков пикселей на изображении, чтобы полусекундный фантомный дорожный знак проскользнул в «малозаметные» части. И хотя исследователи испытали свою технику на экране билборда размером с телевизор на небольшой дороге, они утверждают, что её легко адаптировать к полноценному цифровому рекламному щиту на шоссе, где она может вызвать настоящий хаос.

Сотрудники Ben Gurion далеко не первые, кто продемонстрировал способы обмана датчиков Tesla. Еще в 2016 году одна команда китайских исследователей показала, что они могут подделывать и даже скрывать объекты от сенсоров Tesla с помощью радио, звукового и светоизлучающего оборудования. Совсем недавно другая китайская команда показала, что они могут «взломать» технологию отслеживания полосы движения автопилотом Tesla, чтобы заставить автомобиль поменять полосу движения. Все, что им нужно для этого – просто разместить на дорогу дешевые стикеры.

Стоит отметить, что у Tesla есть особенность, которая не очень радует водителей. Поведение Tesla Autopilot в большей степени зависит от камер и в меньшей степени от радара, тогда как действительно автономные транспортные средства, например, разработанные Waymo, Uber или стартапом-разработчиком автономных транспортных средств Cruise, принадлежащим GM, также обладают лазерным локатором – лидаром.

«Лазерный локатор не восприимчив к атакам такого типа, – объясняет Чарли Миллер, ведущий конструктор по безопасности автономных транспортных средств в компании Cruise. – Вы можете изменить изображение на рекламном щите, но лазерный локатор не обращает на это внимание, поскольку он анализирует информацию о расстоянии и скорости. Поэтому вышеописанные трюки не сработали бы на большинстве по-настоящему автономных автомобилей».

Источник: Wired